|

ИИ VASA1, который может заставить изображения говорить

|

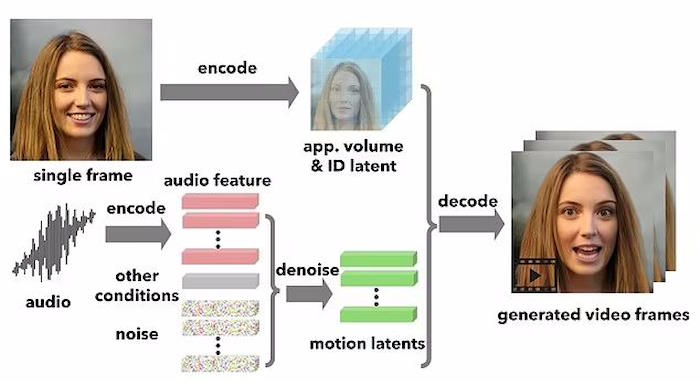

| Граница между реальным и вымышленным становится все тоньше благодаря новому ИИ-инструменту от Microsoft. Технология, получившая название VASA-1, преобразует неподвижное изображение лица человека в анимированный ролик, где он разговаривает или поет. Движения губ "идеально синхронизированы" со звуком, что создает впечатление, будто объект съемки ожил, утверждает технический гигант. В одном из примеров шедевр 16-го века Леонардо да Винчи "Мона Лиза" начинает грубо читать рэп с американским акцентом. Однако Microsoft признает, что инструмент может быть "неправильно использован для выдачи себя за людей", и не выпускает его для широкой публики. VASA-1 создает статичное изображение лица – будь то фотография реального человека или художественное произведение или рисунок вымышленного человека. Затем оно "тщательно" сопоставляется со звуком речи "любого человека", чтобы лицо ожило. ИИ был обучен с помощью библиотеки выражений лица, которая позволяет ему анимировать неподвижное изображение даже в режиме реального времени – во время произнесения звука. В своем блоге исследователи Microsoft описывают VASA как "платформу для создания реалистичных говорящих лиц виртуальных персонажей". |

|

| "Это открывает путь для взаимодействия в режиме реального времени с реалистичными аватарами, которые имитируют поведение человека в разговоре", - говорят они. "Наш метод позволяет не только добиться великолепной синхронизации звука с губами, но и передать широкий спектр эмоций, выразительные оттенки лица и естественные движения головы, которые способствуют восприятию реалистичности и живости". Что касается вариантов использования, команда считает, что VASA-1 может позволить цифровым аватарам с искусственным интеллектом "взаимодействовать с нами так же естественно и интуитивно понятным образом, как и с реальными людьми". Но эксперты поделились своими опасениями по поводу этой технологии, которая, если ее выпустить, может заставить людей говорить то, чего они никогда не говорили. Другим потенциальным риском является мошенничество, поскольку пользователи в Сети могут быть введены в заблуждение с помощью поддельного сообщения с изображением человека, которому они доверяют. Джейк Мур, специалист по безопасности в ESET, сказал: "Видеть - значит больше не верить". "По мере совершенствования этой технологии мы начинаем гонку со временем, чтобы убедиться, что все полностью осведомлены о том, на что она способна, и что им следует дважды подумать, прежде чем принимать корреспонденцию за подлинную", - сказал он MailOnline. |

| Предвосхищая опасения, которые могут возникнуть у общественности, эксперты Microsoft заявили, что VASA-1 "не предназначен для создания контента, который используется для введения в заблуждение". "Однако, как и другие связанные с этим методы создания контента, он все еще потенциально может быть использован не по назначению для выдачи себя за людей", - добавляют они. "Мы выступаем против любых действий, направленных на создание вводящего в заблуждение или вредного контента о реальных людях, и заинтересованы в применении нашей методики для улучшения обнаружения подделок. "В настоящее время видео, созданные с помощью этого метода, все еще содержат идентифицируемые артефакты, и численный анализ показывает, что все еще существует пробел в достижении подлинности реальных видео". Microsoft признает, что существующие технологии все еще далеки от "достижения подлинности естественных говорящих лиц", но возможности искусственного интеллекта быстро растут. По словам исследователей из Австралийского национального университета, искусственные лица, созданные с помощью ИИ, кажутся более реалистичными, чем человеческие. Эти эксперты предупредили, что изображения людей с помощью ИИ, как правило, отличаются "гиперреализмом", когда лица более пропорциональны, и люди ошибочно принимают это за признак человечности. |

| Другое исследование, проведенное экспертами из Университета Ланкастера, показало, что поддельные лица с искусственным интеллектом кажутся более надежными, что влияет на конфиденциальность в Интернете. Тем временем, OpenAI, создатель знаменитого бота ChatGPT, в феврале представил свой "ужасающий" инструмент преобразования текста в видео Sora, который позволяет создавать ультрареалистичные видеоролики с искусственным интеллектом, основанные исключительно на коротких текстовых подсказках. На специальной странице веб-сайта OpenAI представлена богатая галерея фильмов, созданных с помощью искусственного интеллекта, - от человека, идущего по беговой дорожке, до отражений в окнах движущегося поезда и кошки, будящей своего хозяина. Однако эксперты предупреждают, что это может уничтожить целые отрасли, такие как кинопроизводство, и привести к росту количества фальшивых видеороликов в преддверии президентских выборов в США. "Идея о том, что искусственный интеллект может создать гиперреалистичное видео, на котором, скажем, политик совершает что-то предосудительное, должна вызвать тревогу, поскольку мы вступаем в самый напряженный год выборов в истории человечества", - сказал доктор Эндрю Рогойски из Университета Суррея. Исследовательская статья, описывающая новый инструмент Microsoft, была опубликована в виде предварительной печати. |

| Источник |