|

ИИ ищет цели для авиаударов на Ближнем Востоке

|

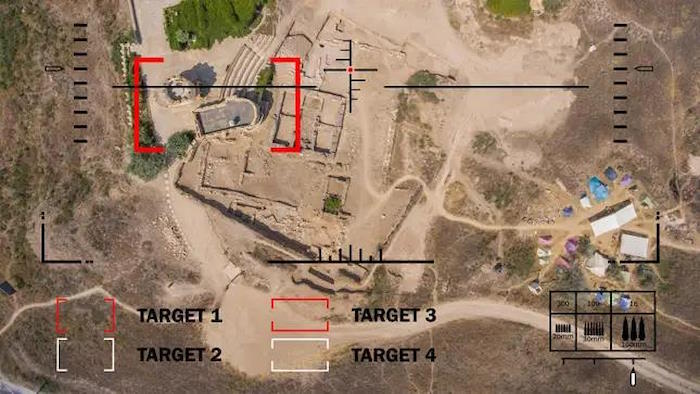

| В этом месяце США использовали искусственный интеллект для идентификации целей, пораженных авиаударами на Ближнем Востоке, сообщил представитель министерства обороны, что свидетельствует о растущем использовании технологии военными в боевых действиях. Алгоритмы машинного обучения, которые могут самостоятельно научиться идентифицировать объекты, помогли сузить круг целей для более чем 85 авиаударов США 2 февраля, по словам Шайлер Мур, технического директора Центрального командования США, которое руководит военными операциями США на Ближнем Востоке. Пентагон заявил, что эти удары были нанесены американскими бомбардировщиками и истребителями по семи объектам в Ираке и Сирии. “Мы использовали компьютерное зрение, чтобы определить, где могут быть угрозы”, - сказал Мур в интервью Bloomberg News. “У нас, безусловно, было больше возможностей для прицеливания за последние 60-90 дней”, - сказала она, добавив, что в настоящее время США ищут “очень много” ракетных установок у враждебных сил в регионе. |

|

| Военные ранее признавали использование алгоритмов компьютерного зрения в разведывательных целях. Но комментарии Мура являются самым убедительным известным подтверждением того, что американские военные используют эту технологию для идентификации вражеских целей, которые впоследствии были поражены огнем оружия. Удары США, которые, по словам Пентагона, уничтожили или повредили ракеты, противоракеты, хранилища беспилотных летательных аппаратов и оперативные центры ополчения среди других целей, были частью ответа администрации Байдена на убийство трех военнослужащих США в результате нападения на базу в Иордании 28 января. США приписали это нападение поддерживаемым Ираном ополченцам. Мур сказал, что системы искусственного интеллекта также помогли идентифицировать ракетные установки в Йемене и надводные суда в Красном море, несколько из которых Центральное командование, или Centcom, заявило, что уничтожило в ходе многочисленных ударов оружием в феврале. Поддерживаемые Ираном ополченцы-хуситы в Йемене неоднократно подвергали ракетным ударам коммерческие суда в Красном море. |

| Алгоритмы таргетинга были разработаны в рамках проекта Maven, инициативы Пентагона, начатой в 2017 году с целью ускорения внедрения искусственного интеллекта и машинного обучения во всем Министерстве обороны и поддержки военной разведки, при этом в прототипах в то время особое внимание уделялось борьбе США с боевиками "Исламского государства". Мур, который базируется в штаб-квартире Centcom в Тампе, штат Флорида, сказал, что вооруженные силы США на Ближнем Востоке экспериментировали с алгоритмами компьютерного зрения, которые могут обнаруживать и идентифицировать цели по изображениям, полученным со спутника, и другим источникам данных, опробовав их на учениях в течение прошлого года. Затем они начали использовать их в реальных операциях после нападения ХАМАСА на Израиль 7 октября и последовавших за этим ответных военных действий в Газе, которые усилили региональную напряженность и нападения боевиков, поддерживаемых Ираном. США и Европейский союз объявили ХАМАС террористической организацией. |

| “7 октября все изменилось”, - сказала Мур. “Мы немедленно перешли на повышенную передачу и гораздо более высокий оперативный темп, чем у нас был ранее”, - сказала она, добавив, что вооруженные силы США смогли “довольно плавно перейти” к использованию Maven после года цифровых учений. Мур подчеркнул, что возможности искусственного интеллекта Maven используются для того, чтобы помочь найти потенциальные цели, но не для их проверки или применения против них оружия. По ее словам, учения в конце прошлого года, в ходе которых Centcom экспериментировал с механизмом рекомендаций ИИ, показали, что такие системы “часто не дотягивают” до людей в предложении порядка атаки или наилучшего оружия для использования. Люди постоянно проверяют рекомендации ИИ по наведению на цель, сказала она. По ее словам, американские операторы серьезно относятся к своим обязанностям и риску того, что искусственный интеллект может совершать ошибки, и “обычно становится довольно очевидно, когда что-то не так”. “Никогда не бывает алгоритма, который просто запускается, приходит к выводу и затем переходит к следующему шагу”, - сказала она. “На каждом этапе, в котором задействован ИИ, в конце проверяется человек”. |

| Источник |