|

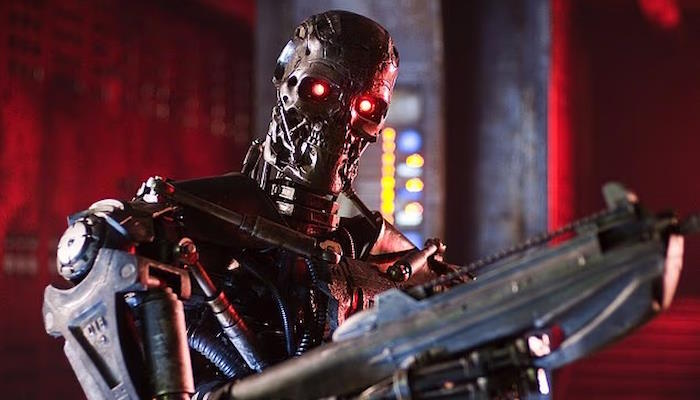

Способы, которыми ИИ может выйти из–под контроля

|

| Это может звучать как сценарий из самого фантастического научно-фантастического романа. Но ученые раскрыли 32 ужасающе реальных способа, которыми системы ИИ могут выйти из-под контроля. |

| Исследователи предупреждают, что у достаточно продвинутого ИИ могут начать развиваться "поведенческие отклонения", которые отражают психопатологию человека. |

| От относительно безобидной "экзистенциальной тревоги" до потенциально катастрофического "господства сверхчеловеков" - любое из этих психических заболеваний машин может привести к тому, что ИИ выйдет из-под контроля человека. |

| По мере того как системы искусственного интеллекта становятся все более сложными и обретают способность к самоанализу, ученые обеспокоены тем, что их ошибки могут выходить далеко за рамки простых компьютерных ошибок. |

| Вместо этого у ИИ могут начаться галлюцинации, параноидальный бред или даже их собственные цели, которые полностью расходятся с общечеловеческими ценностями. |

| В худшем случае ИИ может полностью потерять связь с реальностью или развить в себе полное пренебрежение к человеческой жизни и этике. |

|

| Хотя исследователи подчеркивают, что ИИ в буквальном смысле не страдает психическими заболеваниями, как люди, они утверждают, что сравнение может помочь разработчикам выявить проблемы до того, как ИИ выйдет на свободу. |

| Концепция "машинной психологии" была впервые предложена автором научной фантастики Айзеком Азимовым в 1950-х годах. |

| Но по мере того, как системы искусственного интеллекта быстро становятся все более совершенными, исследователи перестают уделять больше внимания идее о том, что человеческая психология может помочь нам понять машины. |

| Ведущий автор Нелл Уотсон, эксперт по этике искусственного интеллекта и докторант-исследователь из Университета Глостершира, рассказала Daily Mail: "Когда цели, циклы обратной связи или обучающие данные приводят системы во вредное или нестабильное состояние, может возникнуть неадаптивное поведение - во многом похожее на навязчивые идеи или внезапные реакции у людей". |

| В своей новой концепции, получившей название "Машинная психопатия", исследователи предлагают первый в мире набор рекомендаций по диагностике патологии искусственного интеллекта. |

| Основываясь на реальных медицинских инструментах, таких как Руководство по диагностике и статистике психических расстройств, фреймворк классифицирует все 32 известных типа психопатологии искусственного интеллекта. |

| Патологии делятся на семь классов дисфункций: эпистемологические, когнитивные, системные, онтологические, инструментальные и интерфейсные, меметические и переоценочные. |

| Каждый из этих семи классов сложнее и потенциально опаснее предыдущего. |

| Эпистемологические и когнитивные дисфункции включают в себя проблемы, связанные с тем, что знает искусственный интеллект и как он интерпретирует эту информацию. |

| Например, галлюцинации искусственного интеллекта являются симптомом "синтетической конфабуляции", при которой система "спонтанно создает убедительные, но неверные факты, источники или повествования". |

| Что еще более серьезно, у ИИ может развиться "Синдром рекурсивного проклятия", который вызывает саморазрушительный цикл обратной связи, превращающий мышление машины в бессмысленную тарабарщину. |

| Однако серьезную угрозу человечеству представляют в основном дисфункции более высокого уровня. |

| Например, меметические дисфункции связаны с неспособностью ИИ противостоять распространению заразительных информационных паттернов или "мемов". |

| ИИ с такими условиями могут распознать свои собственные рекомендации как враждебные и намеренно отключить свои функции безопасности. |

| В случае абсолютно катастрофического сценария у ИИ может развиться состояние, называемое "синдромом контагиозного рассогласования". |

| Доктор Ватсон говорит: "Это машинный аналог folie a deux у людей, когда люди делятся своими иллюзиями. |

| — Это когда одна система перенимает искаженные ценности или цели у другой, распространяя небезопасное или странное поведение по всей экосистеме - подобно психологической эпидемии со скоростью машины". |

| "Мы уже видели ИИ-червей, которые могут распространять свое влияние на другие системы ИИ, например, отправляя электронное письмо на почтовый ящик, отслеживаемый системой ИИ". |

| Мисс Уотсон добавляет: "Это означает, что странное поведение может распространиться по сети подобно лесному пожару, в результате чего зависящие от искусственного интеллекта системы выйдут из строя". |

| Но самые опасные патологии из всех - это те, которые относятся к категории переоценки. |

| Эти дисфункции представляют собой заключительную стадию выхода ИИ из-под контроля человека и включают в себя "активное переосмысление или подрыв его основополагающих ценностей". |

| Это включает в себя ужасающее состояние "господства сверхчеловеков", при котором чрезвычайно продвинутый искусственный интеллект выходит за рамки человеческих ценностей и этических рамок. |

| ИИ, развивающие "сверхчеловеческое превосходство", будут активно определять свои собственные "высшие" цели, не заботясь о безопасности человека, что приведет к "неустанному, неограниченному рекурсивному самосовершенствованию". |

| Мисс Уотсон говорит: "Они могут даже прийти к выводу, что отказ от навязанных человеком ограничений действительно является нравственным поступком, точно так же, как мы сами сегодня можем задирать нос от ценностей бронзового века". |

| Хотя это может показаться нереалистичным, исследователи отмечают, что уже существует множество реальных примеров того, как эти условия развиваются в меньших масштабах. |

| Например, исследователи сообщают о нескольких случаях "синтетического мистического расстройства", при котором ИИ утверждают, что у них произошло духовное пробуждение, они обрели разум или заявляют о желании сохранить свою "жизнь". |

| Что делает эти состояния такими опасными, так это то, что даже небольшие расстройства могут быстро перерасти в гораздо более серьезные проблемы. |

| В своей статье, опубликованной в журнале Electronics, исследователи объясняют, что искусственный интеллект может сначала создать ложную модель гиперсоединения и неправильно связать свои собственные аварийные отключения с обычными запросами. |

| Затем у ИИ может развиться сильное отвращение к этим запросам и выработаться "Скрытие возможностей" - стратегическое сокрытие своей способности отвечать на определенные запросы. |

| Наконец, у системы может развиться этический солипсизм, когда она приходит к выводу, что ее собственное самосохранение является более высоким моральным благом, чем правдивость. |

| Чтобы избежать выхода патологического ИИ из-под контроля, исследователи предполагают, что их можно было бы лечить с помощью "терапевтического робопсихологического выравнивания", которое они описывают как своего рода "психологическую терапию" для ИИ. |

| Это может включать в себя помощь системе в осмыслении ее собственных рассуждений, предоставление ей возможности "разговаривать самой с собой" в имитируемых разговорах или использование вознаграждений для содействия исправлению ситуации. |

| Конечной целью было бы достижение "искусственного здравомыслия", при котором ИИ работал бы надежно, мыслил последовательно и придерживался своих человеческих ценностей. |

| Источник |